2025-07-30 11:07:55 西盟科技资讯

7月30日,昆仑万维正式推出并开源采用自回归路线的「多模态统一预训练模型Skywork UniPic」,在单一模型中深度融合图像理解、文本到图像生成、图像编辑三大核心能力。该模型基于大规模高质量数据进行端到端预训练,具备良好的通用性与可迁移性。

秉持开放协作、共享创新的理念,昆仑万维面向社区全面开放 Skywork UniPic 的核心资源:

模型权重:

https://huggingface.co/Skywork/Skywork-UniPic-1.5B

技术报告:

https://github.com/SkyworkAI/UniPic/blob/main/UNIPIC.pdf

代码仓库:

https://github.com/SkyworkAI/UniPic

01

Skywork UniPic:统一自回归模型实现图片生成、编辑与理解一体化

GPT-4o的迅速走红,标注着人工智能领域多模态统一预训练模型的成熟。Skywork UniPic 延续了 GPT-4o 的自回归范式,在单一模型中深度融合图像理解、文本生成图像(T2I)与图像编辑三大核心任务,构建了真正统一的多模态模型架构。

传统多模态统一模型多依赖 VQ 或 VAE 编码器来压缩视觉内容,虽然具备一定效果,但也存在局限性,它们更侧重保留图像的视觉细节而非语义信息,这会在一定程度上削弱模型的图像理解能力。

为此,Skywork UniPic 团队借鉴 Harmon 架构设计,并在表征方式上做出关键调整:采用 MAR 编码器作为图像生成路径的视觉表征基础,同时引入 SigLIP2 作为图像理解路径的主干。

该结构设计的核心洞察在于:能否构建一个轻量级统一模型,在保持实际部署可行性的同时,在理解、生成与编辑任务上均达到顶尖性能?

Skywork-UniPic 模型核心能力包含:

图文理解:基于 token 预测完成文本的自回归建模

图像生成:采用掩码自回归方式,逐步生成图像 patch

图像编辑:引入参考图与编辑指令作为条件,生成编辑后的图像

此外,Skywork-UniPic 完成端到端优化流程,能够实现生成、理解、编辑三大能力的协同训练和相互促进,突破传统方法中能力权衡的技术瓶颈。

这一架构设计不仅保持了自回归模型的简洁高效,更通过共享编码器实现了跨任务的深度协同,为多模态统一模型的实用化部署奠定了坚实基础。

用户只需要输入提示词,Skywork-UniPic 既可以像 VLM 一样理解图像、像 T2I 模型一样生成图片,还可以像美图工具一样,一键实现风格转绘/吉卜力化的编辑功能。

02

模型优势:1.5B 轻量级规模性能逼近同类大参数统一模型,诠释了“小而美”的技术美学

团队在追求模型能力极限的同时,也坚持效率重要性的设计理念。Skywork UniPic 以 1.5B 的紧凑参数规模,真正诠释了“小而美”的技术美学:

多重技术亮点

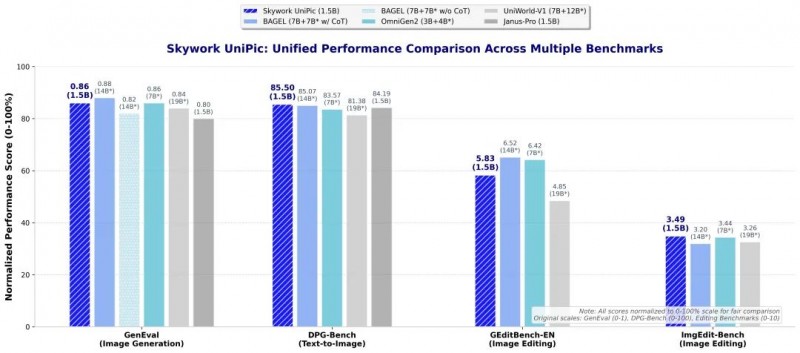

指令遵循能力媲美大型模型:在 GenEval 指令遵循评估中取得 0.86 的优异成绩,超越了绝大多数同类统一模型,在无 CoT 的情况下取得了 SOTA 分数,逼近较大模型 BAGEL(7B+7B*)带 CoT 的 0.88 分;

复杂指令生图能力领先:在 DPG-Bench 复杂指令生图基准上达到 85.5 分的行业 SOTA 水平;

图像编辑能力统一模型第一梯队:GEditBench-EN 获得 5.83 分,ImgEdit-Bench 达到3.49分,展现出精准的编辑执行能力;

参数效率优势显著:相比同类大参数统一模型(如 BAGEL 的 14B 总参数、UniWorld-V1 的 19B 总参数),Skywork UniPic 以 1.5B 的轻量级规模实现了接近甚至超越大参数模型的性能表现;

部署友好,真正可落地:模型在 RTX 4090 消费级显卡上均可流畅运行,为广大开发者和研究者提供了真正可落,地的统一模型解决方案,大幅降低了技术应用门槛。

03

Skywork-UniPic是怎样炼成的?